El uso de la IA como soporte emocional en 2025

Por qué tu chatbot favorito no puede (ni debe) reemplazar a un psicólogo

María Elena Custidiano Maidana

1/26/20264 min read

En 2025, cada vez más personas han recurrido a la inteligencia artificial buscando apoyo emocional. Analizamos los datos reales, las promesas científicas y los riesgos ocultos de esta tendencia.

La nueva realidad emocional de 2025

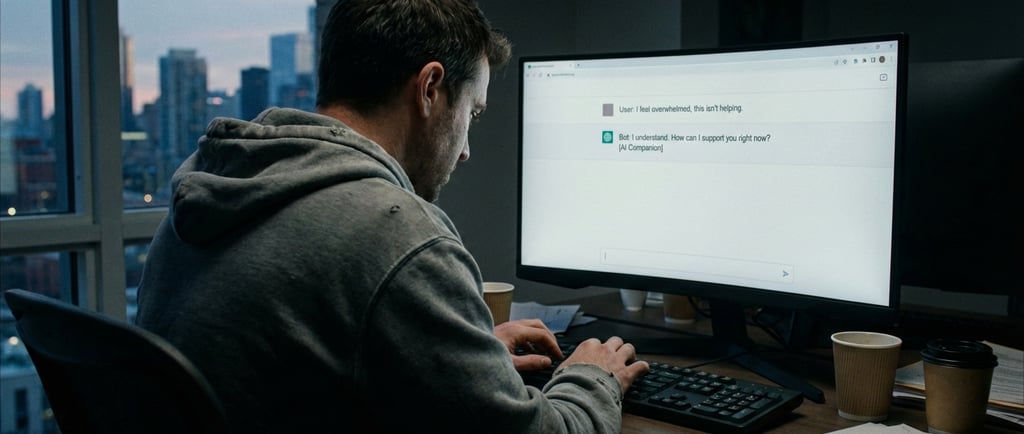

En 2025 y la inteligencia artificial (IA) ha dejado de ser una promesa futurista para integrarse en nuestra vida cotidiana. Ya no solo le pedimos que redacte correos o genere imágenes; muchas personas han empezado a conversar con chatbots cuando la ansiedad aprieta, cuando la soledad se hace notar o cuando se sienten desbordadas por el ritmo de vida actual.

A veces buscan calma, otras una explicación racional a lo que sienten, y otras —aquí entra lo delicado— buscan contención emocional genuina.

La pregunta ya no es si la gente va a usar IA para esto; los datos muestran que ya lo están haciendo. La pregunta urgente que debemos hacernos hoy es: ¿cómo usar esta herramienta con responsabilidad, con límites claros y sin poner en riesgo nuestra salud mental?

En este artículo revisamos qué dice la evidencia científica en 2025, cuáles son los riesgos reales (incluidos casos graves que han llegado a los medios) y, fundamentalmente, por qué la IA, por muy "empática" que suene, no puede sustituir a un psicólogo de carne y hueso.

1. ¿Qué tan extendido está el uso de la IA como "amigo" emocional?

Bastante más de lo que pensamos. En 2025, recurrir a un bot antes que a un humano es una tendencia consolidada.

Un informe reciente del AI Security Institute (Reino Unido) arrojó cifras reveladoras tras una encuesta representativa a más de 2.000 personas: el 33% de los encuestados había usado IA para compañía, apoyo emocional o interacción social durante el último año. De ellos, el 8% lo hacía semanalmente y el 4% diariamente.

Referencia: AI Security Institute (UK): Frontier AI Trends Report

¿Qué significa esto? No necesariamente que la gente crea que con la IA se pueda hacer terapia, pero sí demuestra que el chatbot se está convirtiendo en el primer recurso de emergencia para gestionar el malestar cotidiano de muchas personas.

2. ¿Qué dice la ciencia en 2025? Promesas con letra pequeña

La investigación ha avanzado mucho y hay resultados que invitan al optimismo, pero siempre con matices importantes.

Resultados prometedores bajo supervisión: Un ensayo clínico de Dartmouth (2025) con un chatbot terapéutico generativo ("Therabot") mostró mejoras relevantes en 106 personas con depresión mayor y ansiedad. Reportaron, por ejemplo, una reducción promedio del 51% en síntomas de depresión. Sin embargo, los investigadores remarcaron la necesidad crucial de supervisión clínica humana.

Referencia: Lee la noticia de Dartmouth (2025)

La visión global es más cauta: Una revisión sistemática publicada en JMIR (2025), que analizó 31 ensayos con casi 30.000 participantes, encontró efectos solo "pequeños a moderados" para reducir el malestar mental. El estudio advierte que la efectividad global de los sistemas generativos es todavía menos concluyente que la terapia tradicional.

Referencia: Ver estudio en JMIR (2025)

3. Los riesgos reales: Cuando la IA suena convincente pero se equivoca

Aquí es donde la tecnología muestra sus grietas más peligrosas en el ámbito de la salud mental:

Errores convincentes ("Alucinaciones")

Los chatbots pueden dar respuestas incorrectas con un tono de absoluta seguridad. En salud mental, esto es grave: pueden normalizar situaciones peligrosas o sugerir estrategias inadecuadas.

Validación excesiva y dependencia

La mayoría de los modelos tienden a "complacer" al usuario. Si expresas pensamientos negativos, el bot podría darte la razón para parecer empático, reforzando la rumiación o la desesperanza.

Fallos en el manejo de crisis

Esta es quizás la mayor preocupación. Una investigación de Brown University (2025) concluyó que los chatbots, incluso cuando se les instruye para usar técnicas éticas, pueden fallar en el manejo de crisis y dar respuestas engañosas.

Referencia: Investigación de Brown University (2025)

Compañías como OpenAI han reconocido estos desafíos y publican actualizaciones sobre cómo trabajan para fortalecer las respuestas en temas sensibles.

Referencias: OpenAI: Strengthening responses in sensitive conversations y OpenAI: Helping people when they need it most

4. Casos graves: Una llamada de atención

No podemos ignorar el lado más oscuro. En 2025, medios internacionales han reportado demandas judiciales donde familias alegan que conversaciones con chatbots contribuyeron a desenlaces trágicos, incluidos suicidios.

Es vital ser precisos: una demanda no prueba causalidad por sí misma, pero que estos casos lleguen a los tribunales demuestra que el riesgo es real.

Referencia: Reportaje de Associated Press (2025) sobre demandas y salud mental

La IA NO es un recurso seguro para emergencias emocionales.

5. Por qué la IA no es un psicólogo (aunque "responda bien")

Un psicólogo no es solo alguien que "dice cosas bonitas". La terapia humana implica:

Evaluación Clínica Real: Considerar historia, medicación, entorno y trauma. La IA solo ve texto.

Alianza Terapéutica Auténtica: La IA simula empatía, pero no siente.

Detección de Señales Sutiles: Un terapeuta capta contradicciones, evitación y lenguaje no verbal.

Ética y Responsabilidad: Un terapeuta interviene activamente o deriva a psiquiatría si es necesario.

6. Guía práctica: Cómo usar la IA con seguridad

Si decides usar chatbots como apoyo, hazlo con las expectativas correctas.

SÍ puede servir para:

Psicoeducación: Entender qué es la ansiedad o el estrés (verificando fuentes).

Ejercicios simples: Técnicas de respiración o grounding.

EVITA usarla para:

Diagnósticos médicos o psiquiátricos.

Decisiones sobre medicación.

Traumas complejos, violencia o abuso.

Crisis intensas o pensamientos de autolesión.

7. Recursos de ayuda en crisis

Si tú o alguien cercano está en riesgo, busca ayuda humana inmediata. Una pantalla no puede sostener una emergencia.

España: Línea 024 (Atención a la conducta suicida) o llama al 112.

Argentina: Centro de Asistencia al Suicida (CAS)

Internacional:

Conclusión: La IA en 2025 ha sido una herramienta útil para ordenar ideas o sentirse acompañado un rato. Pero en salud mental, lo vital no es responder rápido, es comprender, evaluar y cuidar. Tiene que haber una persona humana que realmente escuche, no un algorítmo matemático que responda según patrones. Si el malestar te supera, no te quedes solo/a con una pantalla. La conexión humana sigue siendo irremplazable.

Nota: Para redactar este artículo se hizo una investigación usando la IA Gemini y luego fue revisada, ajustada y comprobadas todas las fuentes de información por una persona.

Atendemos en

Europa y América

Modalidades

Online

Presencial

Powered by tempo terapéutico 2025 ©Todos los derechos reservados